India, yang sudah lama menggunakan teknologi untuk meyakinkan publik, telah menjadi pusat perhatian global dalam penggunaan dan penyalahgunaan AI dalam wacana politik, khususnya dalam proses demokratis. Perusahaan teknologi, yang pertama kali membangun alat-alat tersebut, melakukan kunjungan ke negara itu untuk mendorong solusi.

Pada awal tahun ini, Andy Parsons, direktur senior Adobe yang mengawasi keterlibatan perusahaan dalam Content Authenticity Initiative (CAI) lintas industri, melakukan kunjungan ke India untuk bertemu dengan organisasi media dan teknologi di negara tersebut untuk mempromosikan alat-alat yang dapat diintegrasikan ke dalam alur kerja konten untuk mengidentifikasi dan menandai konten AI.

Parsons menambahkan bahwa beberapa perusahaan India — yang saat ini tidak tergabung dalam perjanjian keamanan pemilihan AI Munich yang ditandatangani oleh OpenAI, Adobe, Google, dan Amazon pada Februari — bermaksud untuk membentuk aliansi serupa di negara tersebut.

“Legislatif adalah hal yang sangat sulit. Menganggap bahwa pemerintah akan membuat undang-undang dengan tepat dan cukup cepat di wilayah mana pun adalah sesuatu yang sulit diandalkan. Lebih baik bagi pemerintah untuk mengambil pendekatan yang sangat hati-hati dan memberi waktu,” katanya.

Alat deteksi terkenal tidak konsisten, tetapi mereka merupakan langkah awal dalam memperbaiki beberapa masalah, atau begitulah pendapatnya.

“Konsep ini sudah dipahami dengan baik,” katanya selama kunjungannya ke Delhi. “Saya membantu meningkatkan kesadaran bahwa alat-alat tersebut juga sudah siap. Ini bukan hanya ide. Ini adalah sesuatu yang sudah diterapkan.”

CAI — yang mempromosikan standar bebas royalti, terbuka untuk mengidentifikasi apakah konten digital dihasilkan oleh mesin atau manusia — telah ada sebelum kehebohan saat ini seputar AI generatif: Didirikan pada tahun 2019 dan kini memiliki 2.500 anggota, termasuk Microsoft, Meta, dan Google, The New York Times, The Wall Street Journal, dan BBC.

Sama seperti ada industri yang tumbuh di sekitar bisnis memanfaatkan AI untuk membuat media, ada juga industri kecil yang sedang dibangun untuk mencoba memperbaiki beberapa aplikasi yang lebih jahat dari itu.

Pada bulan Februari 2021, Adobe melakukan langkah lebih jauh dengan membangun salah satu standar tersebut sendiri dan menjadi salah satu pendiri Coalition for Content Provenance and Authenticity (C2PA) dengan ARM, BBC, Intel, Microsoft, dan Truepic. Koalisi ini bertujuan untuk mengembangkan standar terbuka, yang mengambil metadata gambar, video, teks, dan media lainnya untuk menyoroti asal-usulnya dan memberi tahu orang tentang asal file tersebut, tempat dan waktu pembuatannya, dan apakah telah diubah sebelum mencapai pengguna. CAI bekerja dengan C2PA untuk mempromosikan standar tersebut dan membuatnya tersedia untuk masyarakat umum.

Kini, CAI sedang aktif berkomunikasi dengan pemerintah-pemerintah global seperti India untuk memperluas adopsi standar tersebut untuk menyoroti asal usul konten AI dan berpartisipasi dengan pihak berwenang dalam mengembangkan panduan untuk kemajuan AI.

Adobe tidak memiliki apa pun tetapi juga segalanya untuk dipertaruhkan dengan memainkan peran aktif dalam permainan ini. Saat ini belum mengakuisisi atau membangun model bahasa besar (LLM) miliknya sendiri, tetapi sebagai rumah bagi aplikasi seperti Photoshop dan Lightroom, Adobe adalah pemimpin pasar dalam alat-alat untuk komunitas kreatif, jadi tidak hanya membangun produk baru seperti Firefly untuk menghasilkan konten AI secara alami, tetapi juga menyuntikkan produk-produk warisan dengan AI. Jika pasar berkembang seperti yang beberapa orang percayai, AI akan menjadi kebutuhan mutlak jika Adobe ingin tetap berada di puncak. Jika regulator (atau akal sehat) memiliki kata dalam hal ini, masa depan Adobe mungkin sangat bergantung pada seberapa sukses mereka dalam memastikan apa yang mereka jual tidak berkontribusi pada kekacauan.

Lukisan besar di India dalam hal apapun memang merupakan kekacauan.

Google fokus pada India sebagai tempat uji coba untuk melarang penggunaan alat AI generatifnya Gemini dalam konten pemilihan; partai-partai menggunakan AI untuk membuat meme dengan wajah lawan; Meta telah mendirikan “pusat bantuan” deepfake untuk WhatsApp, begitu populernya platform tersebut dalam menyebarkan pesan berdaya AI; dan pada saat negara-negara semakin khawatir tentang keamanan AI dan apa yang harus dilakukan untuk memastikannya, kita harus melihat apa dampaknya dari keputusan pemerintah India pada Maret untuk merelaksasi aturan tentang bagaimana model AI baru dibangun, diuji, dan diterapkan. Ini jelas dimaksudkan untuk mendorong lebih banyak kegiatan AI, bagaimanapun juga.

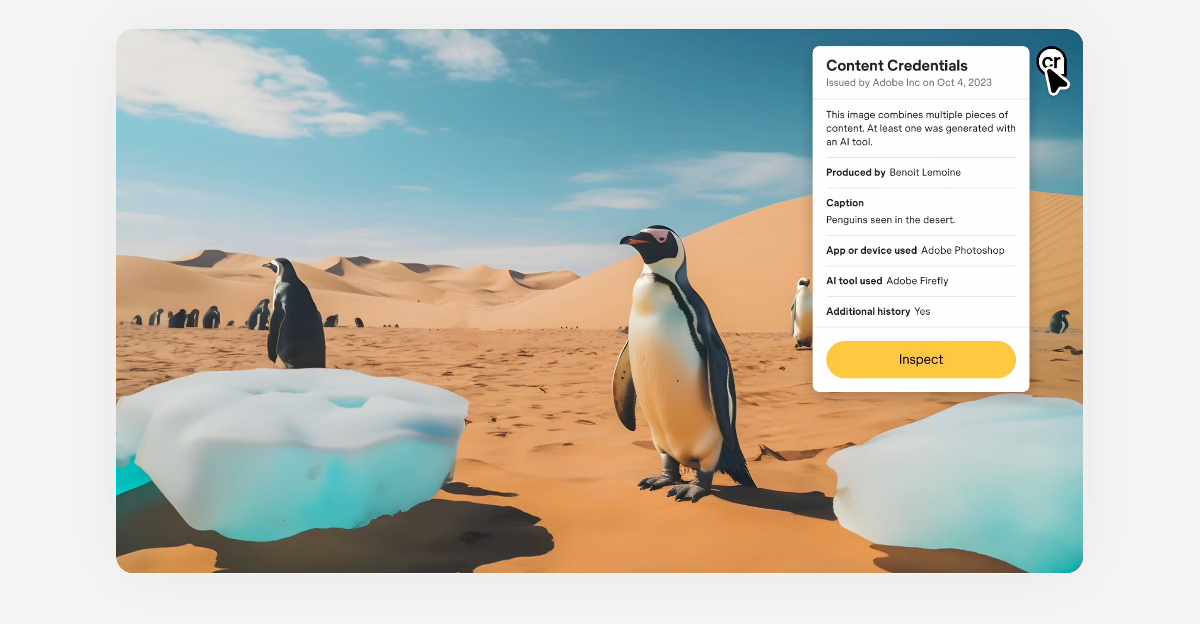

Menggunakan standar terbuka mereka, C2PA telah mengembangkan label nutrisi digital untuk konten yang disebut sebagai Content Credentials. Anggota CAI sedang bekerja untuk menerapkan tanda air digital pada konten mereka untuk memberi tahu pengguna tentang asal-usulnya dan apakah itu dihasilkan oleh AI. Adobe memiliki Content Credentials di semua alat kreatifnya, termasuk Photoshop dan Lightroom. Ini juga secara otomatis melekat pada konten AI yang dihasilkan oleh model AI Adobe Firefly. Tahun lalu, Leica meluncurkan kamera mereka dengan Content Credentials yang sudah terpasang, dan Microsoft menambahkan Content Credentials pada semua gambar yang dihasilkan oleh AI yang dibuat menggunakan Bing Image Creator.

Parsons mengatakan kepada TechCrunch bahwa CAI sedang berkomunikasi dengan pemerintah global dalam dua area: salah satunya adalah untuk membantu mempromosikan standar sebagai standar internasional, dan yang lainnya adalah untuk mengadopsinya.

“Pada tahun pemilihan, sangat penting bagi kandidat, partai, kantor petahana, dan administrasi yang terus-menerus merilis materi ke media dan masyarakat untuk memastikan bahwa dapat diketahui bahwa jika sesuatu dirilis dari kantor PM [Narendra] Modi, itu benar-benar berasal dari kantor PM Modi. Sudah banyak insiden di mana hal tersebut tidak terjadi. Jadi, memahami bahwa sesuatu benar-benar autentik bagi konsumen, fakta-checker, platform, dan perantara sangat penting,” katanya.

Populasi India yang besar, keragaman bahasa dan demografinya membuatnya sulit untuk mengendalikan misinformasi, tambahnya, suara mendukung label sederhana untuk memotong hal tersebut.

“Itu sedikit ‘CR’… dua huruf Barat seperti kebanyakan alat Adobe, tetapi ini mengindikasikan bahwa ada lebih banyak konteks yang harus ditunjukkan,” katanya.

Kontroversi terus mengelilingi apa yang sebenarnya menjadi tujuan perusahaan teknologi mendukung berbagai jenis upaya keamanan AI: Apakah benar-benar tentang kekhawatiran eksistensial, atau hanya sekadar memiliki kursi di meja untuk memberikan kesan kekhawatiran eksistensial, sambil memastikan kepentingan mereka dijaga dalam proses pembuatan aturan?

“Secara umum, tidak kontroversial bagi perusahaan yang terlibat, dan semua perusahaan yang menandatangani perjanjian Munich baru-baru ini, termasuk Adobe, yang berkumpul, mengurangi tekanan persaingan karena gagasan ini adalah sesuatu yang kita semua perlu lakukan,” kata dia membela pekerjaan tersebut.